Bu blogda PyTorch'ta GPU kullanımını artırmanın yollarına odaklanacağız.

PyTorch'ta GPU Kullanımı Nasıl Artırılır?

GPU kullanımını artırmak ve karmaşık makine öğrenimi modellerinin işlenmesi için en iyi donanım kaynaklarının kullanılmasını sağlamak için kullanılabilecek çeşitli teknikler vardır. Bu taktikler kodu düzenlemeyi ve PyTorch özelliklerini kullanmayı içerir. Bazı önemli ipuçları ve püf noktaları aşağıda listelenmiştir:

- Verilerin ve Toplu İş Boyutlarının Yüklenmesi

- Daha Az Belleğe Bağımlı Modeller

- PyTorch Yıldırım

- Google Colab'da Çalışma Zamanı Ayarlarını Ayarlayın

- Optimizasyon için Önbelleği Temizle

Verilerin ve Toplu İş Boyutlarının Yüklenmesi

“ Veri yükleyici PyTorch'ta ' derin öğrenme modelinin her ileri geçişinde işlemciye yüklenecek verinin özelliklerini tanımlamak için kullanılır. Daha geniş ' Parti boyutu ” verisi daha fazla işlem gücü gerektirecek ve mevcut GPU'nun kullanımını artıracaktır.

PyTorch'ta belirli bir toplu iş boyutuna sahip bir Veri Yükleyiciyi özel bir değişkene atamak için kullanılan sözdizimi aşağıda verilmiştir:

Boost_GPU_Utilization = DataLoader ( Parti boyutu = 32 )

Daha Az Belleğe Bağımlı Modeller

Her model mimarisi farklı bir hacim gerektirir. hafıza ”optimum düzeyde performans sergilemek için. Birim zaman başına daha az bellek kullanma konusunda verimli olan modeller, diğerlerinden çok daha büyük toplu iş boyutlarıyla çalışma kapasitesine sahiptir.

PyTorch Yıldırım

PyTorch'un küçültülmüş bir sürümü var: ' PyTorch Yıldırım ”. Adından da anlaşılabileceği gibi ışık hızında performans için optimize edilmiştir. Lightning, varsayılan olarak GPU'ları kullanır ve makine öğrenimi modelleri için çok daha hızlı işlem olanağı sunar. Lightning'in en büyük avantajı, işlemeyi engelleyebilecek ortak koda gerek olmamasıdır.

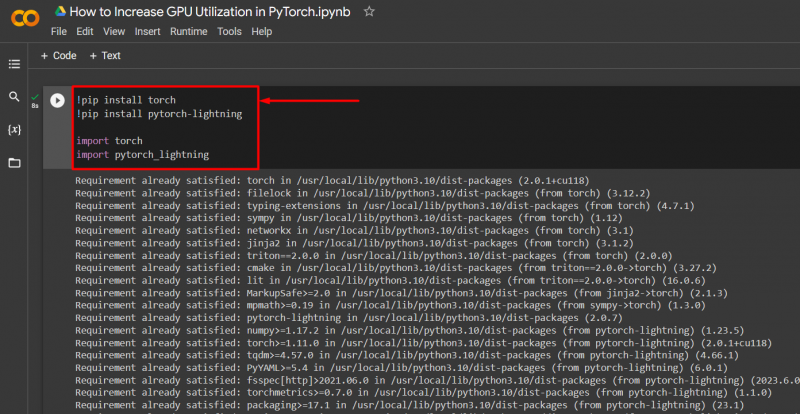

Gerekli kütüphaneleri aşağıda verilen sözdizimi ile bir PyTorch projesine aktarın:

! pip kurulum meşalesi

! pip pytorch'u yükleyin - yıldırım

içe aktarmak meşale

içe aktarmak pytorch_lightning

Google Colab'da Çalışma Zamanı Ayarlarını Ayarlayın

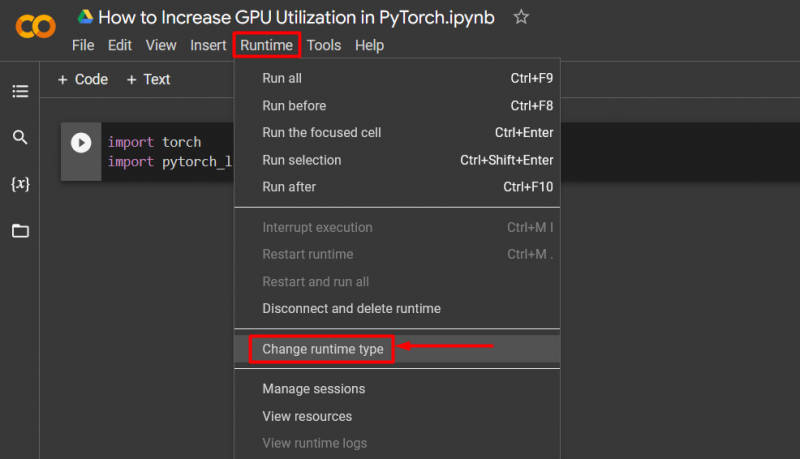

Google Colaboratory, PyTorch modellerinin geliştirilmesi için kullanıcılarına ücretsiz GPU erişimi sağlayan bir bulut IDE'sidir. Varsayılan olarak Colab projeleri CPU üzerinde çalışır ancak ayarlar değiştirilebilir.

Colab not defterini açın ve ' Çalışma süresi Menü çubuğundaki ” seçeneğini seçin ve “ Çalışma zamanı ayarlarını değiştirin ”:

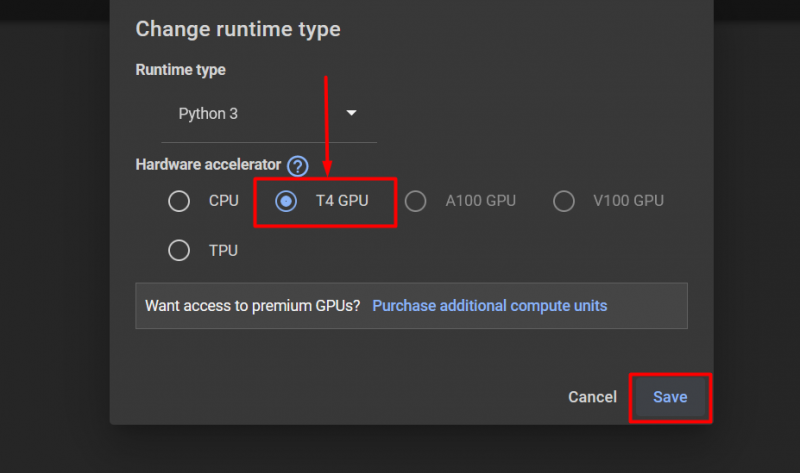

Ardından, “T4 GPU” seçeneğine tıklayın ve “ Kaydetmek GPU'yu kullanmak üzere değişiklikleri uygulamak için:

Optimizasyon için Önbelleği Temizle

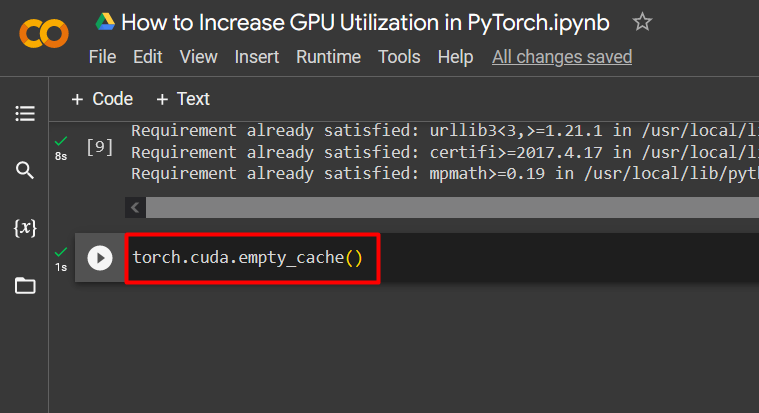

PyTorch, yeni işlemlerin çalıştırılması için yer açabilmek amacıyla kullanıcılarının bellek önbelleğini temizlemesine olanak tanır. “ Önbellek ”, çalıştırılan modellerle ilgili verileri ve bilgileri saklayarak bu modellerin yeniden yüklenmesinde harcanacak zamandan tasarruf sağlar. Önbelleğin temizlenmesi, kullanıcılara yeni modelleri çalıştırmak için daha fazla alan sağlar.

GPU önbelleğini temizleme komutu aşağıda verilmiştir:

meşale. farklı . empty_cache ( )

Bu ipuçları, makine öğrenimi modellerinin PyTorch'ta GPU'larla çalıştırılmasını optimize etmek için kullanılır.

Profesyonel İpucu

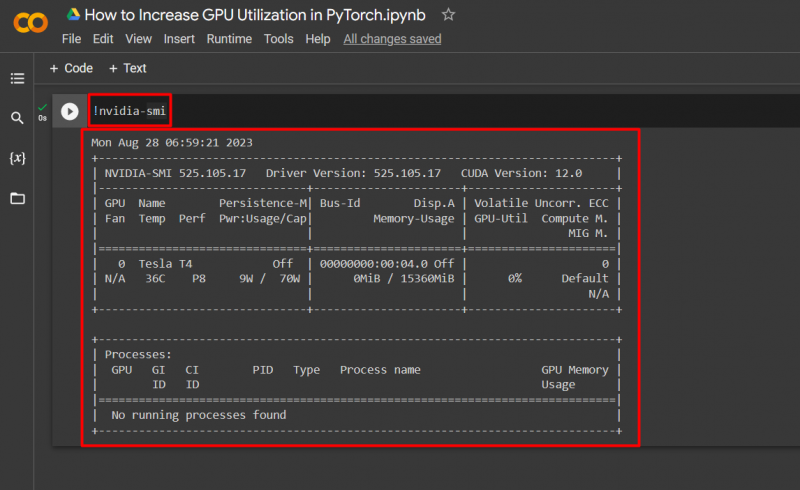

Google Colab, kullanıcılarının GPU kullanımına ilişkin ayrıntılara şu şekilde erişmesine olanak tanır: nvidia ” donanım kaynaklarının nerede kullanıldığı hakkında bilgi almak için. GPU kullanım ayrıntılarını gösterme komutu aşağıda verilmiştir:

! nvidia - gülümseme

Başarı! PyTorch'ta GPU kullanımını artırmanın birkaç yolunu gösterdik.

Çözüm

Önbelleği silerek, PyTorch Lightning'i kullanarak, çalışma zamanı ayarlarını düzenleyerek, verimli modeller kullanarak ve optimum toplu iş boyutlarını kullanarak PyTorch'ta GPU kullanımını artırın. Bu teknikler, derin öğrenme modellerinin en iyi performansı göstermesini ve mevcut verilerden geçerli sonuçlar ve çıkarımlar çıkarabilmesini sağlamada uzun bir yol kat ediyor. GPU kullanımını artırma tekniklerini gösterdik.